OctoAI (anteriormente conocido como OctoML), anunció el lanzamiento de OctoStack, su nueva solución de extremo a extremo para implementar modelos generativos de IA en la nube privada de una empresa, ya sea local o en una nube privada virtual de uno de los principales proveedores. incluidos AWS, Google, Microsoft y Azure, así como CoreWeave, Lambda Labs, Snowflake y otros.

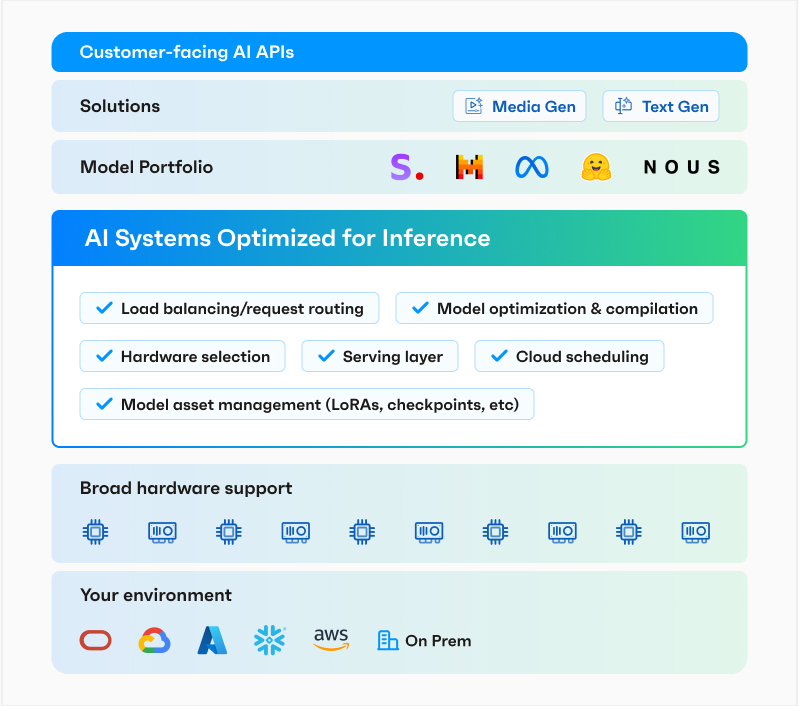

En sus inicios, OctoAI se centró casi exclusivamente en optimizar los modelos para que se ejecutaran de forma más eficaz. Basado en el Apache TVM marco del compilador de aprendizaje automático, la compañía lanzó su plataforma TVM-as-a-Service y, con el tiempo, la expandió hasta convertirla en una oferta completa de servicio de modelos que combinaba sus habilidades de optimización con una plataforma DevOps. Con el auge de la IA generativa, el equipo lanzó la plataforma OctoAI totalmente administrada para ayudar a sus usuarios a servir y ajustar los modelos existentes. OctoStack, en esencia, es esa plataforma OctoAI, pero para implementaciones privadas.

Créditos de imagen: OctoAI

CEO y cofundador de OctoAI Luis Cezé me dijo que la empresa tiene más de 25.000 desarrolladores en la plataforma y cientos de clientes de pago que la utilizan en producción. Muchas de estas empresas, dijo Ceze, son empresas nativas de GenAI. Sin embargo, el mercado de empresas tradicionales que desean adoptar IA generativa es significativamente más grande, por lo que tal vez no sorprenda que OctoAI ahora también las persiga con OctoStack.

“Una cosa que quedó clara es que, a medida que el mercado empresarial pasa de la experimentación el año pasado a las implementaciones, todos están mirando a su alrededor porque están nerviosos por enviar datos a través de una API”, dijo Ceze. “Dos: muchos de ellos también han comprometido su propia computación, entonces, ¿por qué voy a comprar una API cuando ya tengo mi propia computación? Y tres, no importa qué certificaciones obtengas y qué tan grande sea tu nombre, ellos sienten que su IA es tan valiosa como sus datos y no quieren enviarla. Por lo tanto, existe una necesidad realmente clara en la empresa de tener la implementación bajo su control”.

Ceze señaló que el equipo había estado desarrollando la arquitectura para ofrecer tanto su plataforma SaaS como su plataforma alojada desde hacía algún tiempo. Y aunque la plataforma SaaS está optimizada para hardware Nvidia, OctoStack puede admitir una gama mucho más amplia de hardware, incluidas GPU AMD y Inferencia de AWS acelerador, lo que a su vez hace que el desafío de optimización sea un poco más difícil (al mismo tiempo que aprovecha las fortalezas de OctoAI).

La implementación de OctoStack debería ser sencilla para la mayoría de las empresas, ya que OctoAI ofrece la plataforma con contenedores de lectura inmediata y sus gráficos Helm asociados para las implementaciones. Para los desarrolladores, la API sigue siendo la misma, sin importar si apuntan al producto SaaS o a OctoAI en su nube privada.

El caso de uso empresarial canónico sigue utilizando el resumen de texto y RAG para permitir a los usuarios chatear con sus documentos internos, pero algunas empresas también están ajustando estos modelos en sus bases de código interno para ejecutar sus propios modelos de generación de código (similar a lo que ofrece ahora GitHub). a los usuarios de Copilot Enterprise).

Para muchas empresas, poder hacerlo en un entorno seguro que está estrictamente bajo su control es lo que ahora les permite poner en producción estas tecnologías para sus empleados y clientes.

“Para nuestro caso de uso sensible al rendimiento y la seguridad, es imperativo que los modelos que procesan datos de llamadas se ejecuten en un entorno que ofrezca flexibilidad, escala y seguridad”, dijo Dali Kaafar, fundador y director ejecutivo de IA apacible. “OctoStack nos permite ejecutar de manera fácil y eficiente los modelos personalizados que necesitamos, dentro de los entornos que elijamos, y ofrecer la escala que nuestros clientes requieren”.