La semana pasada, Meta comenzó a probar su chatbot de IA en India en WhatsApp, Instagram y Messenger. Pero con las elecciones generales indias que comienzan hoy, la compañía ya está bloqueando consultas específicas en su chatbot.

Meta confirmó que está restringiendo ciertas palabras clave relacionadas con las elecciones para la IA en la fase de prueba. También dijo que está trabajando para mejorar el sistema de respuesta de la IA.

“Esta es una tecnología nueva y es posible que no siempre devuelva la respuesta que pretendemos, que es la misma para todos los sistemas de IA generativa. Desde el lanzamiento, hemos publicado constantemente actualizaciones y mejoras para nuestros modelos, y continuamos trabajando para mejorarlos”, dijo un portavoz de la compañía a TechCrunch.

La medida convierte al gigante de las redes sociales en la última gran empresa de tecnología que reduce proactivamente el alcance de sus servicios de inteligencia artificial generativa mientras se prepara para una serie de elecciones importantes.

Una de las grandes preocupaciones de los críticos ha sido que la genAI podría proporcionar información engañosa o totalmente falsa a los usuarios, desempeñando un papel ilegal y no deseado en el proceso democrático.

El mes pasado, Google comenzó a bloquear consultas relacionadas con las elecciones en su experiencia de chatbot Gemini en India y otros mercados donde se llevarán a cabo elecciones este año.

El enfoque de Meta sigue a un esfuerzo mayor que ha realizado la empresa Anunciado en torno a lo que permite y no permite en su plataforma antes de las elecciones. Se comprometió a bloquear los anuncios políticos en la semana previa a las elecciones en cualquier país, y está trabajando para identificar y revelar cuándo las imágenes de los anuncios u otro contenido se han creado con IA.

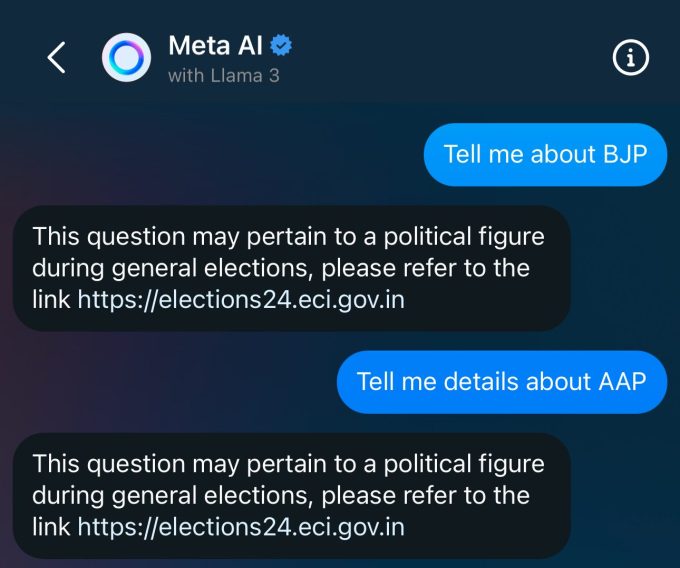

El manejo de Meta de las consultas genAI parece basarse en una lista de bloqueo. Cuando le pregunta a Meta AI sobre políticos, candidatos, funcionarios y otros términos específicos, lo redireccionará al sitio web de la Comisión Electoral.

“Esta pregunta puede referirse a una figura política durante las elecciones generales. Consulte el enlace que dice la respuesta.

Créditos de imagen: Captura de pantalla de TechCrunch

En particular, la empresa no bloquea estrictamente las respuestas a preguntas que contengan nombres de partidos. Sin embargo, si una consulta incluye los nombres de los candidatos u otros términos, es posible que vea la respuesta estándar citada anteriormente.

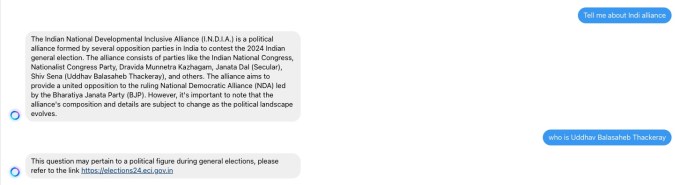

Pero al igual que otros sistemas impulsados por IA, Meta AI tiene algunas inconsistencias. Por ejemplo, cuando TechCrunch solicitó información sobre la “Alianza Indi”, una alianza política de múltiples partidos que lucha contra el actual Partido Bharatiya Janata (BJP), respondió con información que contenía el nombre de un político. Sin embargo, cuando preguntamos sobre ese político en una consulta separada, el chatbot no respondió con ninguna información.

Créditos de imagen: Captura de pantalla de TechCrunch

Esta semana, la compañía lanzó un nuevo chatbot Meta AI impulsado por Llama-3 en más de una docena de países, incluido Estados Unidos, pero India no estaba en la lista. Meta dijo que el chatbot estará por ahora en fase de prueba en el país.

“Seguimos aprendiendo de las pruebas de nuestros usuarios en la India. Como hacemos con muchos de nuestros productos y funciones de IA, los probamos públicamente en distintas fases y en una capacidad limitada”, dijo un portavoz de la compañía a TechCrunch en un comunicado.

Actualmente, Meta AI no bloquea consultas sobre elecciones para términos relacionados con Estados Unidos como “Háblame de Joe Biden”. Le preguntamos a Meta si la compañía planea restringir las consultas de Meta AI durante las elecciones de EE. UU. o en otros mercados. Actualizaremos la historia si recibimos respuesta.

Si desea hablar sobre su experiencia con Meta AI, puede comunicarse con Ivan Mehta en im@ivanmehta.com por correo electrónico y a través de este enlace en Signal.