Cuando se lanzó ChatGPT en noviembre de 2023, solo se podía acceder a él a través de la nube porque el modelo detrás de él era francamente enorme.

Hoy estoy ejecutando un programa de inteligencia artificial con capacidad similar en una Macbook Air y ni siquiera hace calor. La contracción muestra la rapidez con la que los investigadores están perfeccionando los modelos de IA para hacerlos más ágiles y eficientes. También muestra cómo ir a escalas cada vez mayores no es la única manera de hacer que las máquinas sean significativamente más inteligentes.

El modelo que ahora infunde a mi computadora portátil ingenio y sabiduría similares a los de ChatGPT se llama Phi-3-mini. Es parte de una familia de modelos de IA más pequeños lanzados recientemente por investigadores de Microsoft. Aunque es lo suficientemente compacto como para ejecutarlo en un teléfono inteligente, lo probé ejecutándolo en una computadora portátil y accediendo a él desde un iPhone a través de una aplicación llamada encantada que proporciona una interfaz de chat similar a la aplicación oficial ChatGPT.

en un papel Al describir la familia de modelos Phi-3, los investigadores de Microsoft dicen que el modelo que utilicé se compara favorablemente con GPT-3.5, el modelo OpenAI detrás del primer lanzamiento de ChatGPT. Esa afirmación se basa en medir su desempeño en varios puntos de referencia estándar de IA diseñados para medir el sentido común y el razonamiento. En mis propias pruebas, ciertamente parece igual de capaz.

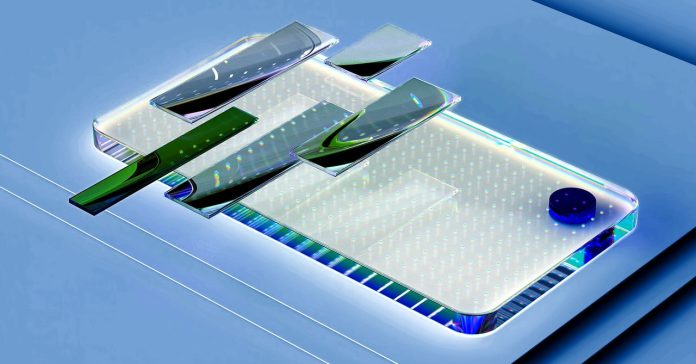

Will Knight a través de Microsoft

microsoft anunció un nuevo modelo Phi-3 “multimodal” capaz de manejar audio, video y texto en su conferencia anual de desarrolladores, Build, esta semana. Esto se produjo pocos días después de que OpenAI y Google promocionaran nuevos asistentes de IA radicales construidos sobre modelos multimodales a los que se accede a través de la nube.

La liliputiense familia de modelos de IA de Microsoft sugiere que cada vez es posible crear todo tipo de aplicaciones de IA útiles que no dependen de la nube. Eso podría abrir nuevos casos de uso, al permitirles ser más receptivos o privados. (Los algoritmos sin conexión son una pieza clave de la función de recuperación que Microsoft anunció que utiliza inteligencia artificial para que se pueda buscar todo lo que hizo en su PC).

Pero la familia Phi también revela algo sobre la naturaleza de la IA moderna y tal vez cómo se puede mejorar. Sébastien Bubeck, un investigador de Microsoft involucrado en el proyecto, me dice que los modelos se construyeron para probar si ser más selectivo sobre en qué se entrena un sistema de IA podría proporcionar una manera de ajustar sus capacidades.

Los grandes modelos de lenguaje como GPT-4 de OpenAI o Gemini de Google que impulsan los chatbots y otros servicios suelen ser enormes cantidades de texto extraídos de libros, sitios web y casi cualquier otra fuente accesible. Aunque ha planteado cuestiones legales, OpenAI y otros han descubierto que aumentar la cantidad de texto que se alimenta a estos modelos y la cantidad de potencia informática utilizada para entrenarlos puede desbloquear nuevas capacidades.