A medida que avanza lentamente la campaña presidencial, la inteligencia artificial continúa acelerándose a un ritmo vertiginoso, capaz de crear una cantidad infinita de imágenes fraudulentas que son difíciles de detectar y fáciles de creer.

Los expertos advierten que para noviembre los votantes habrán presenciado fotografías y vídeos falsificados de candidatos representando un escenario tras otro, con la realidad destrozada y la verdad casi incognoscible.

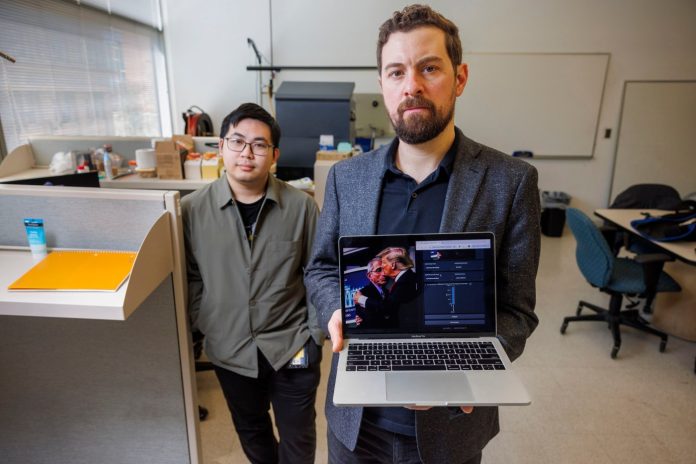

“Esta es la primera campaña presidencial de la era de la IA”, dijo Matthew Stamm, profesor de ingeniería eléctrica e informática de la Universidad de Drexel que dirige un equipo que detecta imágenes políticas falsas o manipuladas. “Creo que las cosas sólo van a empeorar”.

El año pasado, el grupo de Stamm desacreditó un anuncio político del entonces candidato presidencial, el gobernador republicano de Florida, Ron DeSantis, que apareció en Twitter. Mostraba al expresidente Donald Trump abrazando y besando a Anthony Fauci, durante mucho tiempo blanco de la derecha por su respuesta al COVID-19.

Ese lugar fue un “momento decisivo” en la política estadounidense, dijo Stamm, director del Laboratorio de Seguridad de la Información y Multimedia de su escuela. “Nunca antes se había visto el uso de medios creados por IA de manera engañosa en un anuncio de un candidato presidencial importante”, dijo.

“Esto nos mostró que la IA tiene mucho potencial para crear información errónea sobre la votación. Podría volverse una locura”.

Los expertos electorales hablan con temor del potencial de la IA para causar estragos en las elecciones: “evidencias” falsas de mala conducta de los candidatos; vídeos falsos de trabajadores electorales destruyendo papeletas o impidiendo que la gente votara; correos electrónicos falsos que dirigen a los votantes a los lugares de votación equivocados; Textos manipulados que envían instrucciones falsas a los funcionarios electorales que crean una confusión masiva.

El secretario de Estado de Pensilvania, Al Schmidt, dirige un grupo de trabajo sobre amenazas electorales recién formado, cuyo objetivo en parte es combatir la desinformación sobre la votación. En una breve entrevista, Schmidt señaló que en los últimos años hemos visto “con qué facilidad se ha difundido información errónea utilizando métodos mucho más primitivos que la IA: tweets y publicaciones en Facebook sin vídeo ni audio.

“Así que la IA presenta un desafío mucho mayor si se utiliza como arma para engañar a los votantes o dañar a los candidatos”.

Llamada falsa de Biden

Al igual que la propia Internet, la IA puede ser una herramienta poderosa tanto para hacer avanzar como para obstaculizar la sociedad.

Y si bien los malos actores han poseído durante mucho tiempo la capacidad de generar contenido fraudulento en la era digital, la elaboración de textos e imágenes para avergonzar o denigrar a un oponente político alguna vez fue “lenta y dolorosa”, dijo el profesor de informática David Doermann de la Universidad de Buffalo. , Universidad Estatal de Nueva York.

“Usar Photoshop y herramientas de vídeo requirió trabajo”, dijo Doermann. “Necesitabas expertos. Pero ahora, el estudiante promedio de secundaria puede generar deepfakes”.

Los deepfakes son medios sintéticos en los que una persona en una foto o un vídeo se intercambia con la imagen de otra persona, o una persona parece estar haciendo o diciendo algo que no hizo o dijo.

Un ejemplo reciente ocurrió antes de las primarias de enero en New Hampshire. Una llamada automática generada por IA simuló la voz del presidente Joe Biden, instando a los votantes a no participar y “guardar” sus votos para las elecciones de noviembre.

Los votantes promedio podrían haber creído fácilmente que Biden grabó el mensaje y, como resultado, quedar privados de sus derechos, señaló el Campaign Legal Center, un grupo de vigilancia gubernamental no partidista en Washington, DC.

“Este es el primer año que destaca la influencia generalizada de AI antes, durante y después de que los votantes emitan sus votos”, dijo el director ejecutivo de CLC, Adav Noti. “La IA proporciona un fácil acceso a nuevas herramientas para dañar nuestra democracia de manera más efectiva”.

Malas intenciones

La IA permite a personas con intenciones maliciosas trabajar con gran velocidad y sofisticación a bajo costo, según la Agencia de Seguridad de Infraestructura y Ciberseguridad, parte del Departamento de Seguridad Nacional de EE. UU.

Esa rapidez se puso de manifiesto en junio de 2018. El colega de Doermann en la Universidad de Buffalo, Siwei Lyu, presentó un artículo que demostraba cómo se podían detectar vídeos deepfake generados por IA porque nadie parpadeaba; los rostros habían sido transferidos de fotografías fijas.

En tres semanas, los estafadores equipados con IA dejaron de crear deepfakes basados en fotografías y comenzaron a seleccionar videos en los que las personas parpadeaban de forma natural, dijo Doermann, y agregó: “Cada vez que publicamos una solución para detectar IA, alguien la soluciona rápidamente”.

Seis años más tarde, con la IA mucho más desarrollada, “ha adquirido capacidades notables que mejoran diariamente”, dijo la experta en comunicaciones políticas Kathleen Hall Jamieson, directora del Centro de Políticas Públicas Annenberg de la Universidad de Pensilvania. “Todo lo que podamos decir ahora sobre la IA cambiará en dos semanas. Cada vez más, eso significa que los deepfakes no se detectarán fácilmente.

“Deberíamos sospechar de todo lo que vemos”.

“La democracia puede marchitarse”

La desinformación ha brotado como una “manguera de falsedades”, parte de ella proveniente de Rusia, dijo Matt Jordan, director de la Iniciativa de Alfabetización Informativa de la Universidad Estatal de Pensilvania, que ayuda a estudiantes y ciudadanos a distinguir el “periodismo confiable” del “ruido que a menudo abruma y nos divide”, según su sitio web.

La democracia, dijo Jordan, “depende de la capacidad de compartir la realidad”, que la información errónea destruye. En tal atmósfera, advirtió, “la democracia puede marchitarse”.

Los políticos no son los únicos que corren riesgo en esa atmósfera.

Los especialistas en seguridad recomiendan que los trabajadores electorales mantengan privadas las cuentas personales de las redes sociales para que las personas perniciosas armadas con inteligencia artificial tengan menos acceso a sus imágenes y voces. Para evitar la intimidación en línea el día de las elecciones, los expertos también sugieren que los trabajadores electorales utilicen inicios de sesión de varios pasos, frases de contraseña en constante cambio y escaneo de huellas dactilares.

“En 2020, nos encontramos con muchas cosas desagradables relacionadas con las amenazas y tuvimos que luchar para asegurarnos de que nuestra gente se sienta segura”, dijo Schmidt, el principal funcionario electoral de Pensilvania.

La desinformación generada por la IA ayuda a exacerbar la polarización política ya arraigada en todo Estados Unidos, dijo Cristina Bicchieri, profesora de filosofía y psicología de Penn.

“Cuando vemos algo en las redes sociales que se alinea con nuestro punto de vista, incluso si es falso, tendemos a querer creerlo”, dijo.

Para combatir las mentiras, dijo Stamm de Drexel, el consumidor inteligente podría retrasar la publicación de material cargado de emociones de las redes sociales hasta comprobar su veracidad.

Pero eso es mucho pedir.

La reacción humana exagerada ante un informe falso, reconoció, “es más difícil de resolver que cualquier material anti-IA que desarrolle en mi laboratorio.

“Y esa es otra razón por la que estamos en aguas desconocidas”.

_____

(c) 2024 The Philadelphia Inquirer. Visite The Philadelphia Inquirer en www.inquirer.com. DISTRIBUIDO por Agencia de contenido Tribune, LLC.